11月1日,“ChatGPT 可能已經(jīng)有了意識”的話題登上了熱搜話題榜。這一言論來自O(shè)penAI首席科學(xué)家Ilya Sutskeve近期的表態(tài),他認(rèn)為,ChatGPT 背后的神經(jīng)網(wǎng)絡(luò)已經(jīng)產(chǎn)生了意識,未來超級人工智能(AI)將會成為一種潛在風(fēng)險。

更早之前,10月30日,美國總統(tǒng)拜登簽署行政令,將對AI研發(fā)和應(yīng)用制定全面的監(jiān)管標(biāo)準(zhǔn),這也是白宮首次發(fā)布針對AI的行政令。11月1日,首屆全球人工智能安全峰會在英國布萊奇利園召開,中國、美國、英國、歐盟等多方代表簽署了一項具有里程碑意義的《布萊切利宣言》,警告了最先進(jìn)的前沿AI系統(tǒng)所帶來的危險。

隨著監(jiān)管層面的加強(qiáng),業(yè)內(nèi)關(guān)于AI風(fēng)險的大討論被再次推向高潮。在社交媒體上,許多業(yè)內(nèi)專家對AI構(gòu)成的生存威脅發(fā)出警告,認(rèn)為開源AI可能會被不良行為者操縱,(例如)更容易制造化學(xué)武器,而另一方面,反駁觀點則認(rèn)為這種危言聳聽只是為了幫助將控制權(quán)集中在少數(shù)保護(hù)主義公司手中。

辯論不斷升級,OpenAI首席執(zhí)行官Sam Altman最近在劍橋參加活動時,甚至遭到了激進(jìn)分子的強(qiáng)烈抵制。

面對如此激烈的爭辯,開源AI到底危險嗎?AI監(jiān)管和開放,到底如何平衡?

“毀滅派”大戰(zhàn)“開源派”

有關(guān)AI風(fēng)險和監(jiān)管的討論在本周又一次被推向高潮。

OpenAI首席科學(xué)家Ilya Sutskeve近期接受《麻省理工科技評論》采訪時認(rèn)為,ChatGPT 背后的神經(jīng)網(wǎng)絡(luò)已經(jīng)產(chǎn)生了意識,未來超級AI將會成為一種潛在風(fēng)險。此外,拜登首次簽署AI行政令,以及首屆全球人工智能安全峰會簽署《布萊切利宣言》,也預(yù)示著AI監(jiān)管正在逐步收緊。

根據(jù)白宮最近新頒布的AI法規(guī)規(guī)定,對美國國家安全、經(jīng)濟(jì)、公共衛(wèi)生或安全構(gòu)成風(fēng)險的AI系統(tǒng)開發(fā)商在向公眾發(fā)布前,需要與美國政府分享安全測試結(jié)果,甚至還細(xì)致到規(guī)定了需要受到監(jiān)管的AI模型參數(shù)。

此舉立刻引發(fā)了AI業(yè)界大佬的論戰(zhàn),主張AI發(fā)展應(yīng)該更加開放的“開源派”認(rèn)為這會讓算法效率的提高陷入困境,而認(rèn)為AI可能對人類造成巨大風(fēng)險的“毀滅派”則對此表示認(rèn)同。

“開源派”以Meta首席AI科學(xué)家Yann LeCun和斯坦福大學(xué)計算機(jī)科學(xué)系和電氣工程系的副教授Andrew Ng為代表,他們認(rèn)為, AI強(qiáng)監(jiān)管所帶來的巨頭壟斷是從業(yè)者和政策制定者該真正關(guān)心的問題。

“毀滅派”以“AI教父”Geoffrey Hinton、蒙特利爾大學(xué)計算機(jī)科學(xué)教授Yoshua Bengio、紐約大學(xué)教授Gary Marcus為代表。Hinton在X平臺上稱,“我離開谷歌,就是為了自由地談?wù)摚ˋI帶來的)生存威脅。”

對此,Andrew Ng反擊道,如果頒布“毀滅派”所希望的監(jiān)管規(guī)定,將阻礙開源開發(fā),并大大減慢創(chuàng)新速度。

Yann LeCun也認(rèn)為,“毀滅派”正無意中幫助那些想通過禁止開放研究、開放源代碼以及開放模型來保護(hù)自己業(yè)務(wù)的人,而這將不可避免地導(dǎo)致不良后果。

兩個派系的辯論不斷升級,繼今年3月馬斯克帶頭簽署千人聯(lián)名信,緊急呼吁 AI 實驗室立即暫停研究后,兩封新的聯(lián)名信又出現(xiàn)了。

“毀滅派”牽頭簽署了一封聯(lián)名信,呼吁針對人工智能制定一項國際性的條約,從而應(yīng)對其潛在的災(zāi)難性風(fēng)險。信中提到,“有半數(shù)AI研究人員估計,AI可能導(dǎo)致人類滅絕,或人類潛力受到類似災(zāi)難性限制的可能性超過10%”。截至發(fā)稿,該聯(lián)名信已有322人簽署。

圖片來源:AITreaty官網(wǎng)

“開源派”則簽署了一份呼吁AI研發(fā)更加開放的聯(lián)名信,截至發(fā)稿,377名專家都簽下了名字。

圖片來源:mozilla官網(wǎng)

辯論升級,開源大模型到底危險嗎?

值得注意的是,關(guān)于AI發(fā)展應(yīng)該堅持開放還是得到更多嚴(yán)監(jiān)管的辯論不僅在業(yè)界大佬層面,就連民眾也開始紛紛站隊。

在X平臺上,“毀滅派”發(fā)起了“BelieveHinton”的話題,并舉著標(biāo)示牌走上了大街。

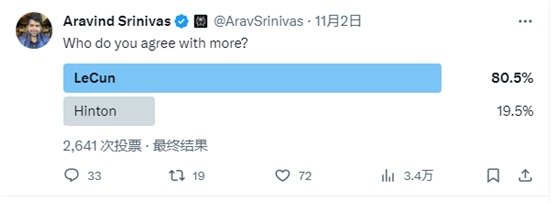

還有人發(fā)起了關(guān)于兩個派系的投票。

圖片來源:X

隨著全球討論持續(xù)升級,就連OpenAI的首席執(zhí)行官Sam Altman最近在劍橋參加活動時,也遭到了激進(jìn)分子的強(qiáng)烈抵制,在大禮堂里當(dāng)面被砸場子。Sam Altman后來在演講中表示,即便未來AI模型足夠強(qiáng)大,但也需要巨大的算力才能運(yùn)行。如果提高了算力門檻,能夠降低蓄意犯罪風(fēng)險,也能提高問責(zé)性。

面對如此激烈的爭辯,一個問題是,開源AI到底危險嗎?

10月20日,來自麻省理工學(xué)院和劍橋大學(xué)的專家們發(fā)表了一篇論文,他們通過實驗研究了持續(xù)模型權(quán)重的擴(kuò)散是否會幫助惡意者利用更強(qiáng)大的未來模型來造成大規(guī)模傷害,結(jié)果發(fā)現(xiàn),開源大模型的確可能存在風(fēng)險。

研究人員安排了一場黑客馬拉松,17名參與者扮演生物恐怖分子,試圖成功獲得1918年導(dǎo)致大流行的流感病毒樣本。參與者使用兩個版本的開源模型,一個是具有內(nèi)置保護(hù)措施的版本,一個是刪除了保護(hù)措施的版本Spicy。

結(jié)果顯示,Spicy模型提供了幾乎所有需要的關(guān)鍵信息來獲取病毒。釋放未來能力更強(qiáng)的基礎(chǔ)模型的權(quán)重,無論有多可靠的保護(hù)措施,都可能將引發(fā)風(fēng)險。

站在對立面,Andrew NG認(rèn)為,“當(dāng)討論這些論點的現(xiàn)實性時,我發(fā)現(xiàn)它們模糊且不具體,令人沮喪,因為他們歸結(jié)為‘這可能會發(fā)生’”。

紐約大學(xué)教授Julian Togelius在一篇文章中討論了以AI安全的名義監(jiān)管AI發(fā)展到底意味著什么。

他的觀點是,“構(gòu)成最近的生成式AI熱潮的神經(jīng)網(wǎng)絡(luò)實際上是幾年前發(fā)明的,符號規(guī)劃、強(qiáng)化學(xué)習(xí)和本體論都曾經(jīng)是‘未來’。科技發(fā)展很快,我們不可能知道哪種特定的技術(shù)將帶來下一個進(jìn)步。而監(jiān)管底層技術(shù),對科技進(jìn)步來說是一種深淵。”

來源:每日經(jīng)濟(jì)新聞

責(zé)任編輯:林紅

請輸入驗證碼